Первым и наиболее важным этапом внутренней СЕО-оптимизации сайта является выполнение технических доработок. Как правило, данная процедура проводится перед началом продвижения сайта и только один раз, затем возможна корректировка некоторых технических составляющих.

Технические доработки, или техническая оптимизация сайта, — это комплекс работ, призванных скорректировать технические аспекты сайта, чтобы улучшить его взаимодействие с роботами поисковых систем. Основной целью оптимизации сайта является обеспечение максимально полной и быстрой индексации страниц. Без принятия таких мер эффективное продвижение сайта может стать невозможным или будет затруднено.

Внесение технических изменений на сайте — задача специалистов, которые обладают соответствующими знаниями и опытом. При неквалифицированном вмешательстве в код сайт может стать полностью неработоспособным.

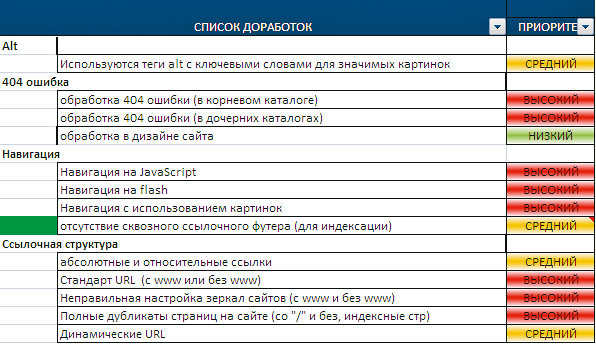

Внутренняя оптимизация сайта проводится постепенно, по шагам. Технические доработки делятся на следующие группы.

Устранение проблем хостинга и оптимизация кода. Если хостинг ненадежный, а в коде много мусора, страница будет долго грузиться. Обычно это негативно отражается на поведенческих факторах. Таким образом, всегда нужно вначале оптимизировать код и устранить проблемы с хостингом. Дополнительно следует исправить ошибки, которые возникают в разных браузерах.

Настройка редиректов и статус-кодов. Эти процедуры необходимы, чтобы произвести склейку дублей страниц, настройку зеркал и корректную обработку ошибки 404.

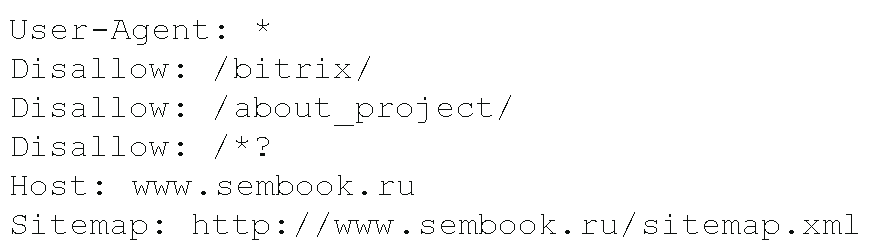

Сопутствующие настройки сайта. Если файл robots.txt составлен корректно, то он будет запрещать или разрешать индексацию страниц, дублей и разделов сайта, указывать основное зеркало. Создание файла sitemap.xml облегчит поисковику работу по индексации всех страниц.

Внутренние корректировки страниц сайта. Индексация может быть значительно осложнена или даже невозможна, если навигация сайта или страницы целиком построена на технологии flash. При внутренней оптимизации страниц сайта элементы flash, frame, JavaScript дублируются в html.

Настройка URL страниц. Псевдостатические адреса являются оптимальными для внутренней СЕО-оптимизации сайта. Их настройка происходит в файле .htaccess. При этом важно учитывать корректную настройку редиректов со старых URL на новые.

Устранение дублей страниц и аффилиатов. Наличие на сайте копий (внутренних или внешних) может привести к наложению санкций со стороны поисковых систем. Поэтому такая доработка требует особого внимания. Стоит также учитывать, что на работу с аффилиатами обычно нужно немало времени. Это трудоемкий процесс, особенно если продвигаемый сайт уступает аффилиату.

Другие технические доработки. Помимо вышеперечисленных работ может потребоваться удаление входной неинформативной страницы, устранение страниц с идентификаторами сессий, исправление битых ссылок и другое. Все это зависит от типа сайта.

Доработки по технической оптимизации сайта

Доработки по технической оптимизации сайтаПравильная и полная оптимизация сайта — залог корректной и быстрой индексации страниц поисковыми системами.

Устранение проблем хостинга и оптимизация кода сайта

Устранение проблем хостинга

На продвижение сайта в поисковых системах оказывают влияние технические параметры хостинга. К негативным параметрам можно отнести:

низкий аптайм (время бесперебойной работы) хостинга. Робот может посетить сайт, когда тот недоступен. Это приводит к понижению ресурса в ранжировании, а иногда и к исключению из индекса;

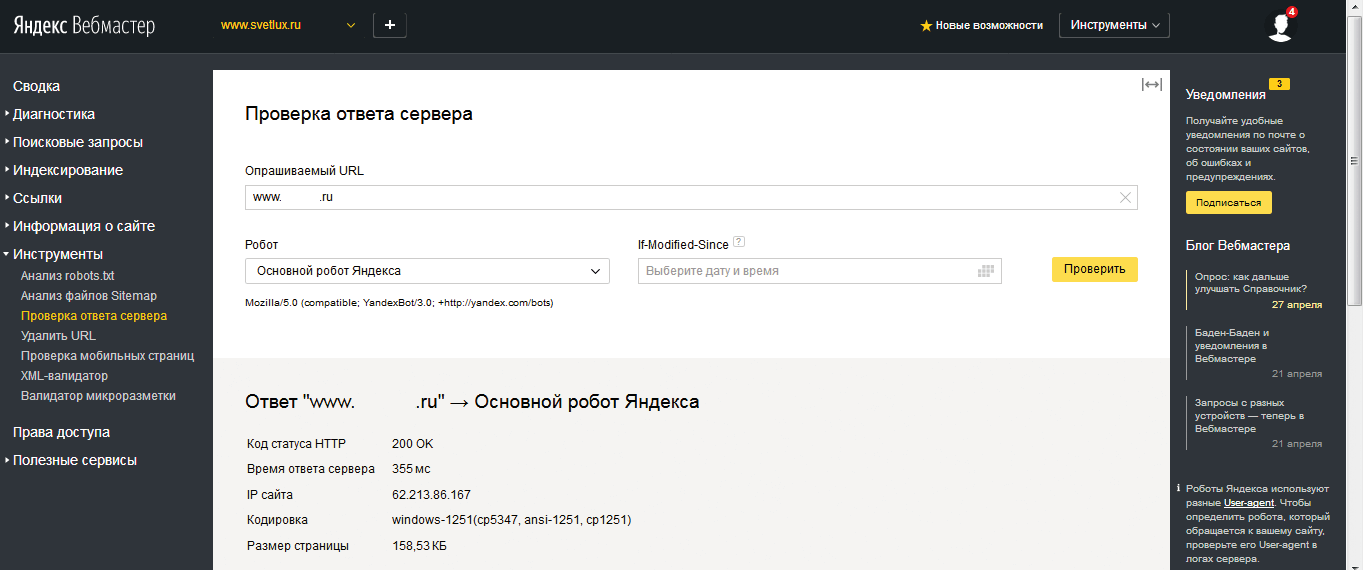

длительное время отклика сервера. Чем короче ожидание ответа, тем лучше, так как и робот, и посетители смогут быстрее получить доступ к сайту. Для проверки времени отклика сервера нужно зайти в «Яндекс.Вебмастер» в разделе «Инструменты» — «Проверка ответа сервера». Также это можно это сделать через сторонние сервисы;

Проверка ответа сервера в Яндекс.Вебмастере Проверка ответа сервера

Проверка ответа сервераналичие IP-сервера хостинга в спам-листах поисковых систем, почтовых сервисов и др. Это создает проблему некорректного использования форм, взаимодействующих с почтой на сайте.

Если на продвигаемом сайте обнаружена одна или несколько таких проблем, следует:

обратиться в службу поддержки хостинга для устранения выявленных проблем. Иногда требуется перейти на более дорогой тариф;

заняться оптимизацией скриптов сайта, так как они могут замедлять работу сервера. С таким заданием справляются веб-разработчики;

сменить хостинг, если нет возможности найти другое решение проблемы. Но стоит учитывать, что этот процесс довольно сложный и трудоемкий, он требует специальных знаний.

Чтобы выбрать надежный хостинг, необходимо для начала сравнить предложения компаний, которые фигурируют в топе выдачи по запросу «хостинг», а также выслушать рекомендации на специализированных форумах, почитать обзоры, к примеру на сайте hostobzor.ru.

При перегрузке сервера запросы к сайту не успевают отрабатываться. Чтобы это исправить, можно настроить в robots.txt директиву . С ее помощью будет задаваться минимальный период времени между обращениями к сайту.

Проверка валидности html-кода

Для успешной индексации имеет значение не только место размещения сайта, но и валидность кода. При его нарушении затрудняется вся работа. Так, к примеру, если закрыты не все открывающие теги, могут возникнуть проблемы в отображении сайта.

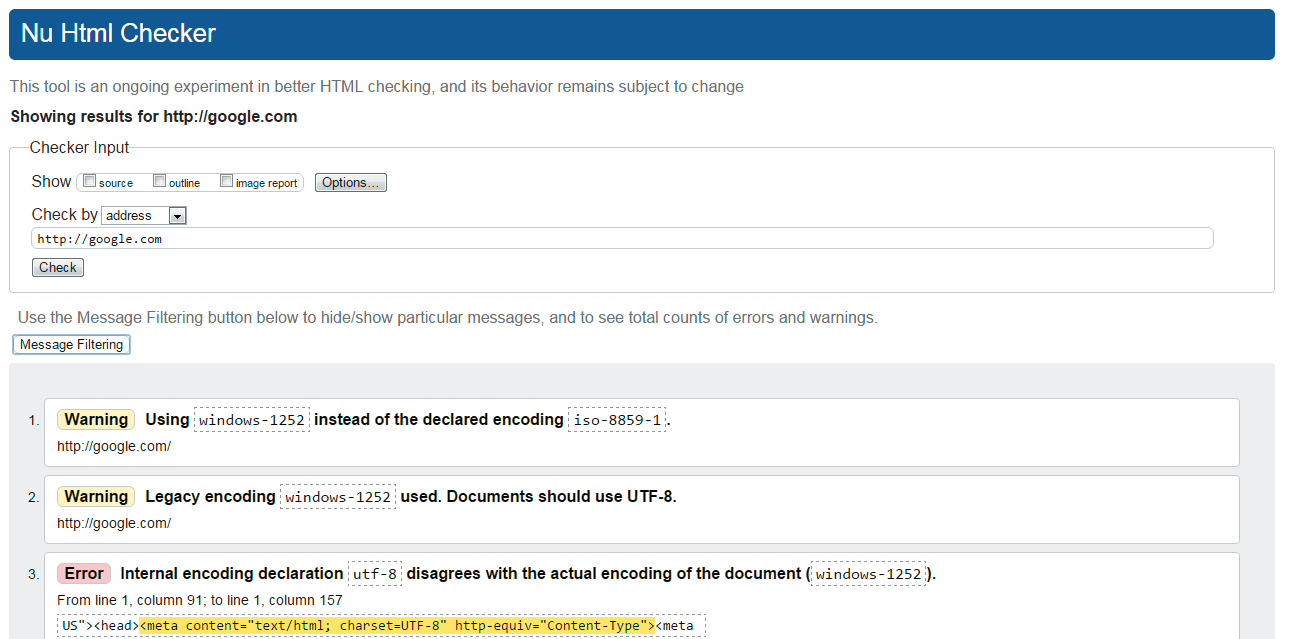

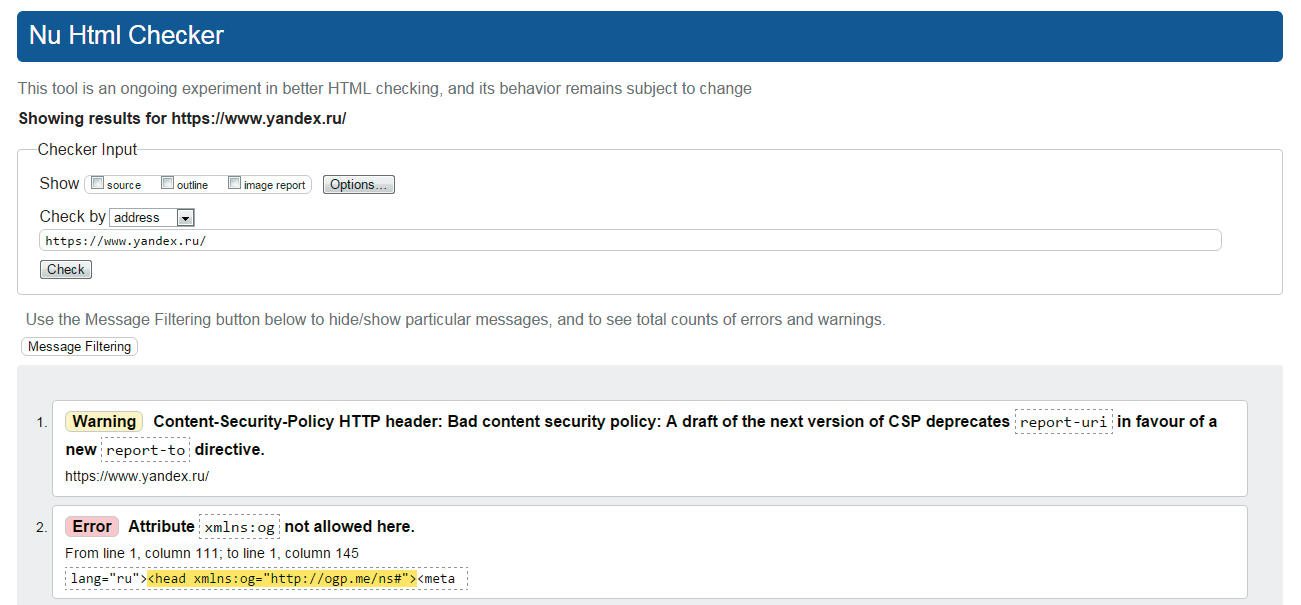

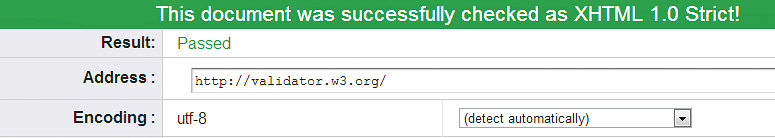

Валидностью кода можно считать соответствие кода сайта принятым мировым стандартам W3C2. Эти стандарты настолько жесткие, что даже сайты основных поисковых систем не признаны валидными на все 100 %.

Проверка валидности HTML-кода

Проверка валидности HTML-кода HTML-Checker

HTML-CheckerПочему могут возникать несоответствия? Этому есть несколько причин:

процесс стандартизации сайта отличается высокой трудоемкостью, не каждый специалист может с ней справиться. Поэтому, если требуется валидация крупного динамического ресурса, необходимо найти опытного веб-разработчика;

даже при валидности, кода нет полной гарантии кроссбраузерности. Кроме того, она не застрахует от уже существенных ошибок, если использовать старые браузеры.

При ранжировании сайта по наиболее конкурентным запросам валидность кода выступает дополнительным бонусом: она показывает серьезность ресурса. Проверить валидность кода можно, используя сервис . Он показывает количество ошибок, где они расположены и дает рекомендации по их исправлению. Проведя анализ и исправив последовательно ошибки, можно достичь в итоге валидности.

Сервис Markup Validation Service

Сервис Markup Validation ServiceCSS и оптимизация кода

При индексировании учитывается размер документа. По информации, предоставленной «Яндексом», можно судить, что веб-страницы «тяжелее» 10 Мбайт не индексируются. Более «легкие» страницы удобнее для пользователей: они загружаются быстрее и «съедают» меньше трафика.

Оптимизация кода сайта — это технический процесс, который основан на сокращении объема кода сайта роботам и отдаваемого посетителям. Благодаря такой внутренней оптимизации роботы поисковых систем могут быстрее индексировать сайт, снижается нагрузка на сервер. Если у ресурса высокая посещаемость, то оптимизация кода является для него обязательной процедурой. Для анализа содержания веб-страниц и выявления решений по оптимизации кода можно использовать сервис (Google).

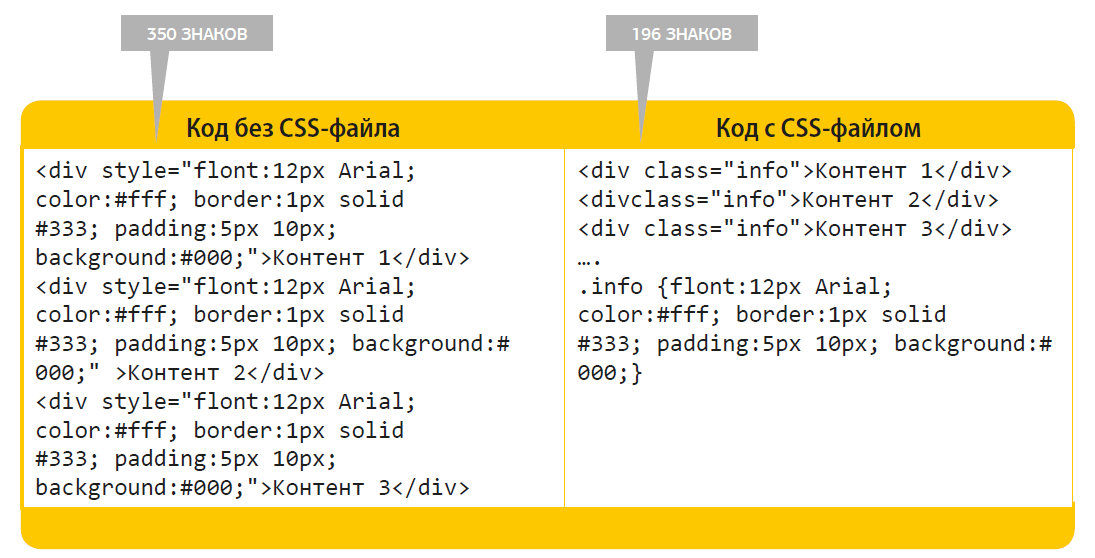

Также оптимизировать код можно за счет создания файла CSS. В нем описываются стили документа.

Существует 2 основных способа задания стилей. Это можно сделать непосредственно в html-коде (на самой странице практически в каждой строчке), но это делает код громоздким. Также стили задаются в специальном CSS-файле. Это сокращает объем html-кода.

Способы задания CSS-стилей

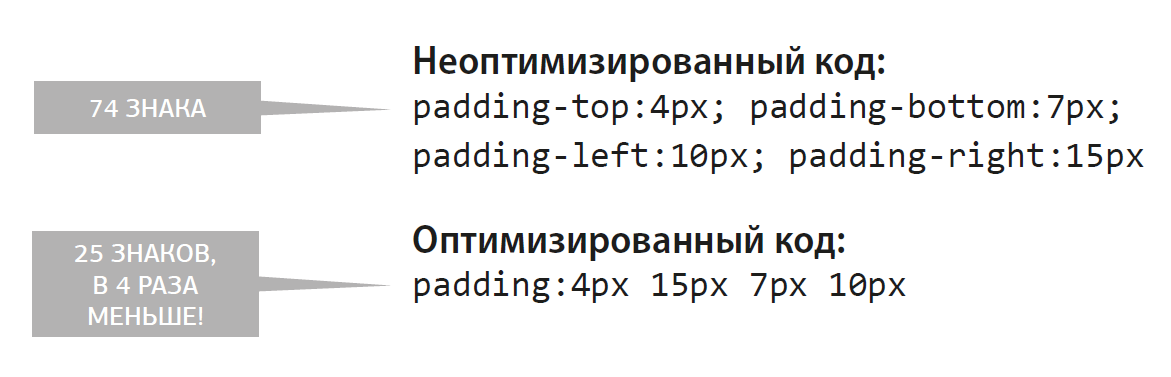

Способы задания CSS-стилейПри использовании CSS-файла необходимо обеспечивать его быструю загрузку с помощью компрессии или сжатия. Также следует выполнять его оптимизацию.

Пример оптимизированного и неоптимизированного кода

Пример оптимизированного и неоптимизированного кодаНастройка правильной кодировки сайта

Кодировка является еще одним элементом кода сайта, который отдается и пользователю, и поисковым системам.

Проблемы с кодировкой обычно встречаются у старых сайтов, чьи страницы редактировались, например в «Блокноте» или подобных инструментах, а код сохранялся в одном из множества различных форматов. Сейчас браузеры не могут распознать такие кодировки самостоятельно.

Чтобы русскоязычный контент отображался корректно, настройка кодировки сайта должна быть верной (например, Windows-1251 или UTF-8). Если выдача текста происходит в других кодировках, то некоторые знаки и символы могут искажаться. Это приводит как к потере посетителей сайта, которые могли бы стать потенциальными клиентами, так и к возможной некорректной индексации.

Неправильная кодировка

Неправильная кодировкаСуществует несколько способов для определения кодировки, отдаваемой сайтом.

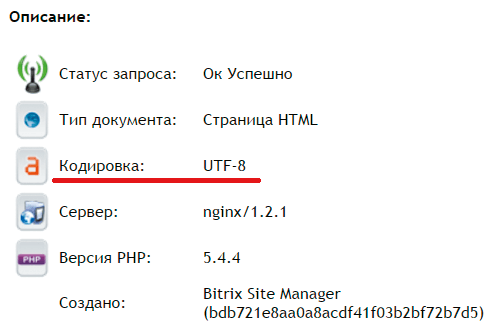

С помощью различных инструментов (например, или ). Также получить необходимую информацию можно при комплексном анализе сайта сервисом .

Способ определения кодировки на странице Способ определения кодировки

Способ определения кодировкиС помощью изменения исходного кода страницы в браузере. Для этого нужно найти тег meta http-equiv и в конце его указать правильную кодировку: Windows-1251 или UTF-8.

При отсутствии данных о кодировке требуется исправить эту ситуацию. Для этого производится настройка правильной выдачи кодировки сервером. Это может быть кириллица Windows-1251 или UTF-8. С данной задачей также справится веб-разработчик.

Настройка статус-кодов и редиректов

Код статуса HTTP сообщает о состоянии страницы. Он отдается автоматически в тот момент, когда робот поисковой системы или браузер посетителя запрашивает страницу на сайте. Благодаря этому коду поисковые роботы могут распознать состояние сайта и конкретной страницы: существует она или нет, настроена ли переадресация, есть ли на стороне сервера ошибка.

Существует 5 групп кодов состояний, которые начинаются с определенной цифры:

zz1xx — сообщают о процессе передачи данных;

zz2xx — информируют об успешности работы сайта;

zz3xx — редирект-коды, которые перенаправляют запрос на другой URL;

zz4xx — коды ошибок клиента, они сообщают, что работа сайта на стороне клиента невозможна;

zz5xx — коды ошибок сервера, они сообщают, что работа сайта на стороне сервера невозможна.

Иногда отдача статус-кода происходит некорректно. К примеру, рабочие страницы могут отдавать код 404, как будто они недоступны. Еще одна частая ошибка — код 200 у несуществующих страниц. В таких случаях требуется настройка статус-кодов в файле .htaccess.

Настройка статус-кодов играет важную роль при индексации сайта. Так, если рабочая страница отдает код 404, она не будет проиндексирована поисковыми роботами, что скажется отрицательно на продвижении.

Чтобы получить информацию о страницах с ошибками, можно обратиться к сервисам «Яндекс.Вебмастер» и SearchConsole (Google), которые настраиваются для конкретного сайта.

Проверка статус-кодов в идеале должна проводиться для всех страниц сайта. При нахождении страницы с кодами, отличными от 200 ОК, необходимо настроить сервер так, чтобы страницы с полезным контентом отдавали корректные ответы. С таким заданием справится разработчик сайта.

Чтобы корректно работать с сайтом, нужно знать и понимать значение следующих кодов:

200 — страница успешно открыта сервером, она может быть проиндексирована роботом поисковой системы;

301 — постоянное перенаправление, которое показывает роботу и посетителю, что запрашиваемая страница не существует, но есть аналогичная, на нее и осуществляется редирект;

302 — временное перенаправление, которое означает, что действие существующего редиректа временно (например, до окончания редизайна сайта;

404 — страница не найдена, поисковики считают такую страницу несуществующей и не индексируют ее;

503 — сервер временно недоступен (например, проблема с нагрузкой сервера, на котором лежит сайт);

500 — внутренняя ошибка сервера, которая возникает, если сервер сталкивается с некорректной работой сайта (например, превышены разрешенные права на хостинге).

Настройка зеркал сайтов

В отдельную группу можно отнести ошибки, которые связаны с некорректной настройкой зеркал сайта.

Зеркалами называются два идентичных сайта с разными URL. Создание таких сайтов поисковые системы могут расценить в качестве спамного действия и наложить санкции. Чтобы этого не произошло, нужно корректно настроить зеркала и указать основное.

В некоторых случаях робот-зеркальщик может определить зеркала без дополнительных настроек, тогда склейка произойдет автоматически. Но бывает и наоборот. Если в поисковой системе произошел сбой и потерялась информация о зеркалах, сайт потеряет позиции. При этом ссылочная масса учитывается на каждый сайт в отдельности, а дублирующая информации ведет к пессимизации и исключению из индекса.

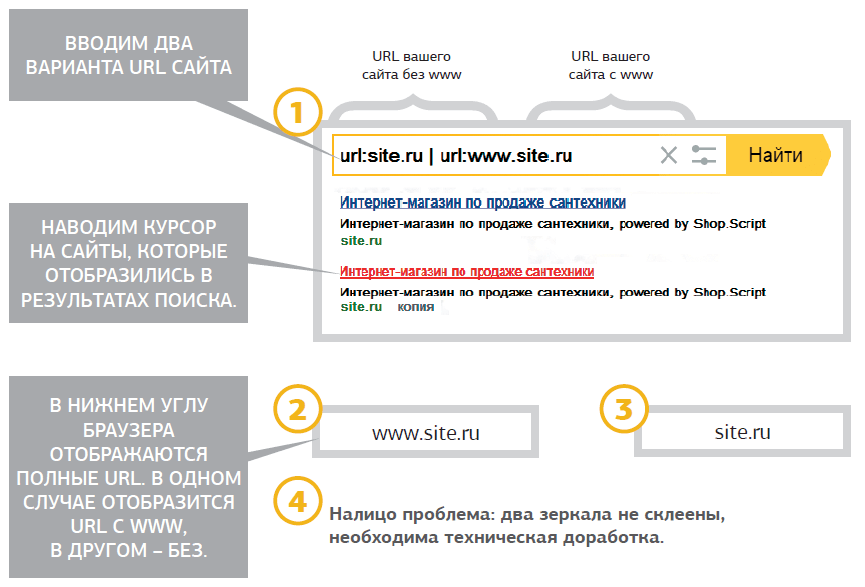

Зачастую возникают проблемы с настройкой зеркал сайтов с www и без www. Для их обнаружения надо:

Как найти зеркала сайта

Как найти зеркала сайтаДля оценки настройки зеркал с www и без www следует зайти в каждую копию и убедиться, что сайт открывается по обоим адресам, или обнаружить, что в одном из вариантов происходит перенаправление. Также необходимо проверить наличие страниц с www и без www в индексе «Яндекса» и Google. Если все на месте, то с большей вероятностью можно сказать, что зеркала настроены верно

Чтобы настроить зеркала, кроме редиректа нужно использовать директиву host в файле robots.txt. Если в файле robots.txt директива host не прописана, то «Яндекс» и другие поисковые системы не получают информацию о главном зеркале. Из-за этого индексация сайта, скорее всего, пройдет некорректно.

При внутренней оптимизации сайта настройка зеркал производится по следующим этапам:

устанавливается 301-й редирект с неосновного зеркала на основное;

корректируется ссылочная структура сайта (это исключает наличие на веб-ресурсе ссылок сразу с неосновного и основного сайтов);

обозначается главное зеркало в директиве host основного сайта.

Перенаправления: редирект 301 и 302

Существует два вида перенаправлений:

301 — «перемещен навсегда». Такой редирект используется при изменении URL страниц и склейке сайтов. Таким образом, прежняя страница выпадает из индекса, но заработанный ею вес практически полностью переходит новой странице, на которую сделан редирект;

302 — «перемещен временно». Такой редирект отвечает за временное перенаправление. Он может быть применен, например, на время редизайна сайта. 302-й редирект сохраняет прежнюю страницу в индексе, не передавая ее вес.

Чтобы узнать тип редиректа, можно проверить статус-кодов страниц, с которых идет перенаправление. Статус-код 302 говорит о том, что установлен временный редирект и его нужно исправить. Рекомендуется полностью устранить такой редирект с сайта, а страницу, например, закрыть настройкой 404-й ошибки.

Если цель редиректа — перенаправлять пользователей с одной страницы на другую, стоит заменить 302-й редирект301-м. Он нормально воспринимается поисковой системой.

Так выглядит настройка 301-го редиректа с помощью директивы RewriteRule модуля mod_rewrite (.htaccess) основных перенаправлений:

Редирект 301 с сайта без www на ресурс с www

RewriteEngine On

RewriteCond %{HTTP_HOST} ^yoursite.com$ [NC]

RewriteRule^(.*)$ [R=301,L]

В обеих строках вместо yoursite.com прописывается свой домен, остальное остается без изменений. Если производится настройка с сайта www на сайт без www, то в предпоследней строчке перед названием сайта надо добавить www, а в последней строчке www удалить.

Редирект 301 для изменения адреса страницы

RewriteEngineOn

RewriteCond %{HTTP_HOST} ^yoursite.com$ [NC]

Redirect 301 /old.html

Редирект старого домена на новый

RewriteEngine On

RewriteCond %{HTTP_HOST} olddomen.net

RewriteRule (.*) [R=301,L]

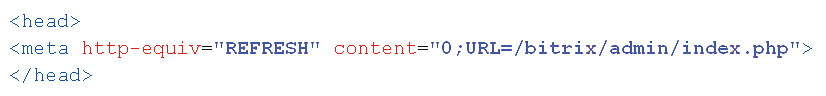

Есть и еще один редирект — с использованием метатега Refresh. При его выполнении в течение нескольких секунд после загрузки страницы автоматически загружается другая. Метатег Refresh достаточно часто прописывается в шаблонах сайта. Но важно знать, что такая переадресация может расцениваться поисковыми роботами как нарушение лицензии, а значит, может повлечь запрет индексации и бан.

Данный изъян обнаружить довольно просто. Если при заходе на страницу производится перенаправление на другую страницу и если в исходном коде страницы присутствует директива metarefresh с указанием URL, куда производится перенаправление, то на сайте используется редирект с помощью метатега Refresh.

Метатег REFRESH

Метатег REFRESHТакой редирект необходимо устранять. Это можно сделать двумя способами: убрать перенаправление, указывая действительные страницы, или вместо имеющегося организовывать 301-й редирект.

Рекомендуется не допускать таких ошибок, чтобы поисковые системы могли корректно индексировать сайт.

Как настроить файлы robots.txt и sitemap.xml

Успешность индексирования сайтов поисковыми роботами во многом зависит от корректности составления файлов robots.txt и sitemap.xml.

Настройка robots.txt

Файл robots.txt — это текстовый документ, расположенный в корневой директории сайта. Он используется для управления страницами, которые попадают под индексацию. Файл robots.txt может накладывать запрет на передвижение поискового робота по сайту и индексирование содержимого сайта.

В файле robots.txt есть директивы, которым обычно следуют поисковые роботы. Поэтому при первом заходе на сайт они проверяют наличие данного документа, а потом перепроверяют его от случая к случаю. Если файла robots.txt не существует или вместо него выдается страница Not Found («Не найдено»), поисковые роботы сталкиваются с трудностями при индексации сайта. Для проверки наличия файла нужно набрать в браузере следующий URL (site.ru — это название вашего домена):

Файл robots.txt

Файл robots.txtЕсли по данному адресу не выдается текстовый файл с директивами для поисковых роботов, то robots.txt отсутствует на сайте. Его следует загрузить в корневую директорию ресурса и прописать корректное содержание.

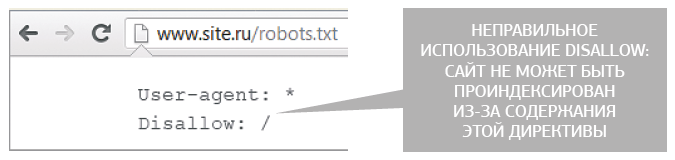

Запрет к индексации сайта

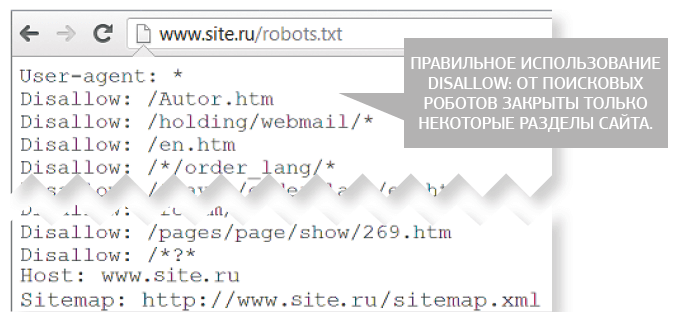

Запрет к индексации сайта Правильное использование директивы disallow

Правильное использование директивы disallowЧаще всего для закрытия сайта от индексации используется следующий способ. В файле robots.txt прописывается «Disallow:/». Такая конструкция обычно используется при редизайне или создании сайта, чтобы поисковый робот не обрабатывал еще неготовые страницы. Главное — после завершения всех работ не забыть снять это ограничение, заменив конструкцию «Disallow:/» на «Аllow:/» или «Disallow:».

Различные конструкции помогают закрывать от индексации определенные разделы сайта, а другие, наоборот, открывать. Но с robots.txt нужно работать очень внимательно, так как при неверном использовании конструкции «Allow-Disallow» есть риск закрытия от индексации полезного раздела.

Allow и disallow — это две противоположны директивы. Если allow разрешает индексирование страниц, то disallow, наоборот, запрещает. Если параметры пустые, их значение меняется на противоположное. Пустая директива Allow (буквально означает «разрешить ничего», т. е. запрет на индексацию сайта) может по-разному считываться поисковыми роботами. Так, «Яндекс» видит ее как ошибку, а не как запрещающий сигнал к индексированию. Google же распознает эту директиву так же, как и «Disallow: /». Но для корректной индексации и исключения ошибок лучше использовать все директивы по прямому назначению.

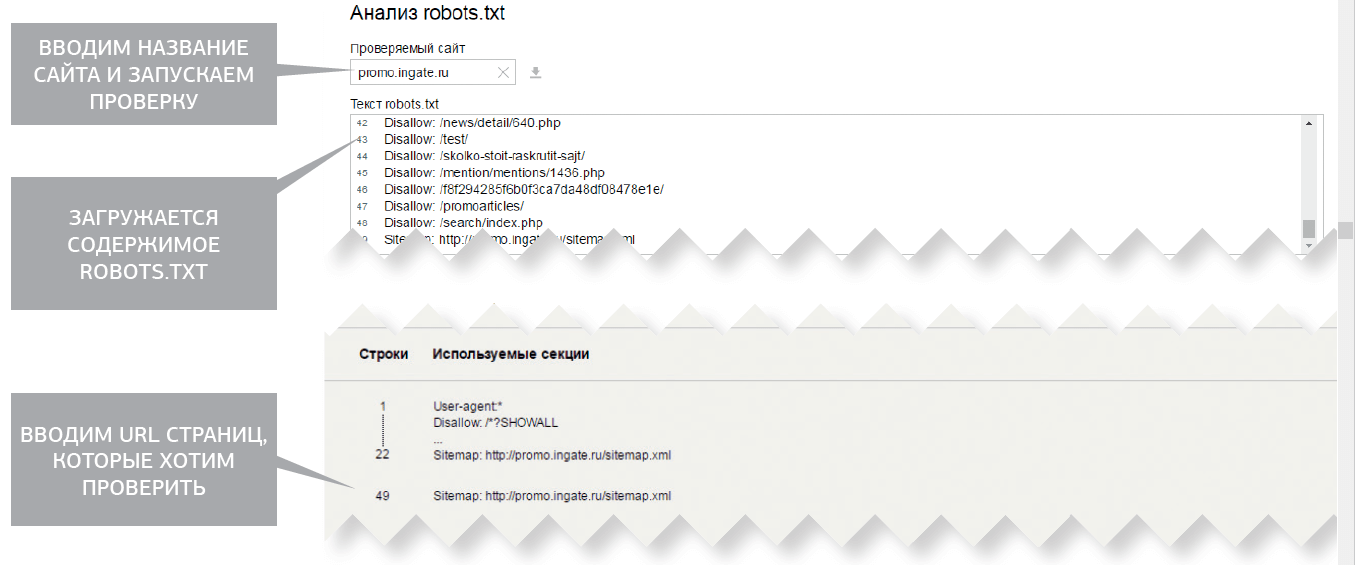

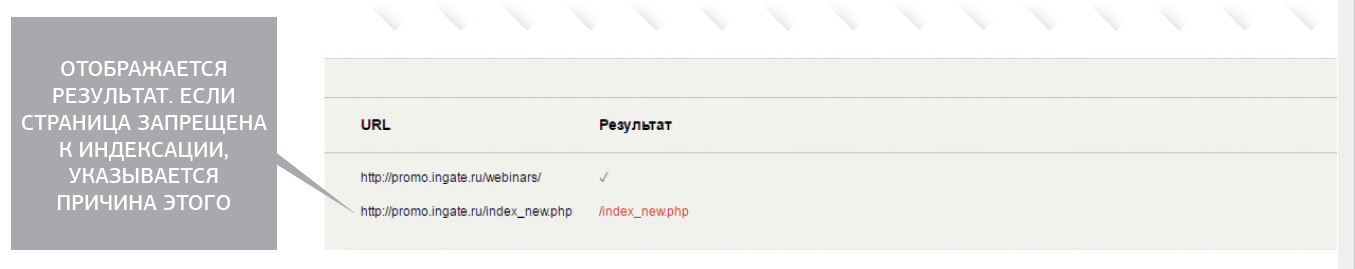

Для проверки индексации определенного раздела сайта можно воспользоваться сервисом

Рассмотрим эту ситуацию на примере «Яндекс.Вебмастера». Для начала нужно указать, с какого сайта загрузить robots.txt, затем в блоке «Разрешены ли URL?» прописать список URL для проверки и нажать кнопку «Проверить». Результат проверки будет выведен по каждому адресу. В Google есть свой аналогичный сервис, который представлен в Search Console. Нужно зайти в раздел «Сканирование» и далее «Инструмент проверки файла robots.txt».

Инструмент проверки файла robots.txt

Инструмент проверки файла robots.txt Результат проверки файла robots.txt

Результат проверки файла robots.txtКогда составляется техническое задание на доработку сайта, в него обязательно закладывается проверка robots.txt. В первую очередь пересматриваются каталоги и страницы, закрытые от индексации директивой Disallow. Желательно подробно оценить их содержание, чтобы решить, насколько информация полезна для посетителей и поисковых роботов. Если это не служебные каталоги и дубликаты страниц, а разделы, представляющие определенную ценность, нужно изменить содержание директивы Disallow и открыть их для индексации.

Noindex и nofollow

Запрет на индексацию определенной страницы можно прописать не только с помощью файла robots.txt, но и с помощью метатега «ROBOTS» в заголовках каждой страницы. Этому метатегу могут соответствовать 4 значения, указываемые в атрибуте CONTENT:

index — индексировать;

noindex — не индексировать;

follow — следовать по ссылкам;

nofollow — не следовать по ссылкам.

Значения «index» и «follow» не могут навредить, т. к. они используются только при открытии определенной страницы для индексации и учета ссылок. А вот, если «noindex» и «nofollow» расставлены неверно, то они могут представлять собой угрозу.

Если необходима индексация страницы без передачи веса по ссылкам и запрет на переход робота по ссылкам с данной страницы, используется следующий код: meta name="robots" content="nofollow".

Если нужно применить оба правила, в атрибуте «content» нужно указать два параметра через запятую.

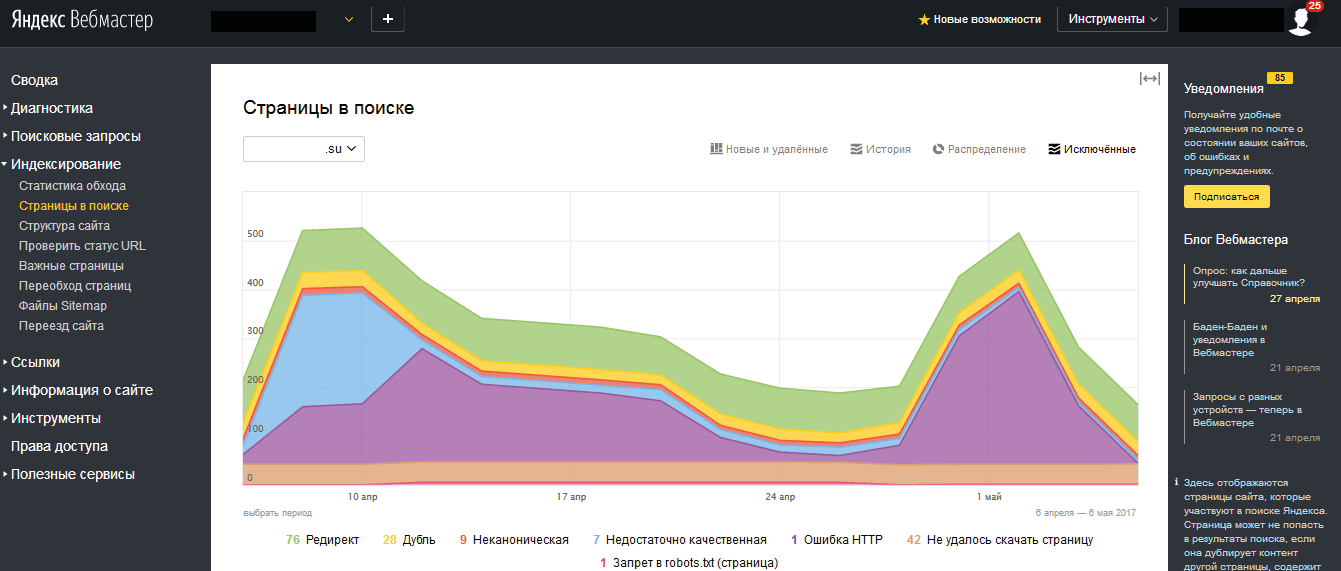

Бывает и так, что файл robots.txt в порядке, а страница все равно не индексируется. В этом случае нужно проверить метатеги «robots» на ней вручную или с помощью «Яндекс.Вебмастера». Для этого надо зайти в раздел «Индексирование — Страницы в поиске», в подраздел «Исключенные страницы». Там можно отслеживать статусы страниц и выявлять причины проблем с индексированием. Чтобы было удобнее анализировать, данные можно выгрузить. Такая же выгрузка делается в Search Console Google в разделе «Сканирование» — «Ошибки сканирования».

Индексирование — Страницы в поиске

Индексирование — Страницы в поискеИногда требуется запретить индексацию не всей страницы, а отдельных фрагментов кода. Такое может быть, если они содержат неуникальный или бесполезный контент. В таком случае понадобятся теги noindex. С ними достаточно просто работать. Между этими тегами в коде сайта заключается соответствующий текст, например: [noindex]Заимствованный контент[/noindex]. Но злоупотребление данным тегом может привести к обратному результату, если поисковый робот будет видеть несвязный текст. Он может посчитать данную страницу спамной.

Атрибут rel ссылки со значением «nofollow» сообщает поисковой системе, что данную гиперссылку не следует учитывать при индексировании страницы.

Поисковые системы не учитывают ссылки с таким атрибутом при расчете индекса цитирования веб-ресурсов. Закрывая таким образом ссылки, мы сохраняем вес страницы на сайте, не передавая его внешним ресурсам.

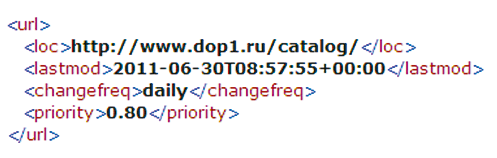

Настройка sitemap.xml

Sitemap.xml — это файл формата xml, содержащий ссылки на все страницы сайта, подлежащие индексации поисковыми системами.

sitemap.xml

sitemap.xmlС помощью этого файла можно указать роботу-индексатору, какие страницы следует индексировать, как часто это делать и какие страницы имеют наибольшее значение. Поэтому помимо адресов страниц сайта в файле sitemap. xml могут содержаться относящиеся к ним данные:

lastmod — время последнего обновления стра-ницы;

changefreq — частота обновления;

proirity — важность данной страницы относи-тельно других.

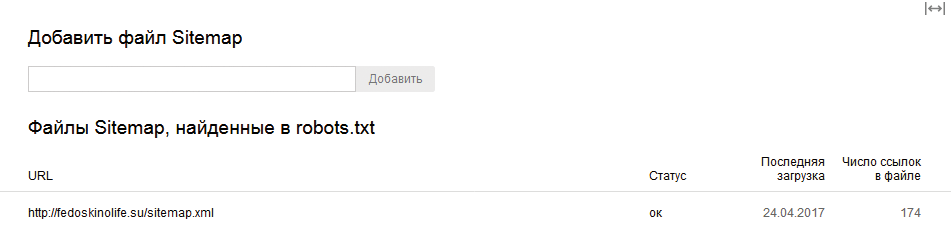

Чтобы указать поисковой системе на xml-карту, следует воспользоваться сразу двумя способами (для подстраховки):

Указать в «Яндекс.Вебмастере» адрес sitemap.xml в со-ответствующем разделе. В Google Search Console раздел «Сканирование» — «Файлы Sitemap».

- Добавление файла sitemap.xml в Вебмастер Яндекса

Добавление sitemap.xml в Вебмастер Яндекса

Добавление sitemap.xml в Вебмастер Яндекса Указать путь в файле robots.txt. По умолчанию sitemap.xml располагается в корневой директории сайта.

Путь к sitemap.xml в robots.txt

Путь к sitemap.xml в robots.txtДля генерации файла sitemap.xml существуют различные веб-сервисы. Например, если ваш сайт содержит не более 500 страниц, можно воспользоваться сервисом для генерации xml-карты — . Для более крупных ресурсов (от 10 тыс. страниц), как правило, пишется специальный программный модуль, автоматически генерирующий карту сайта в xml-формате.

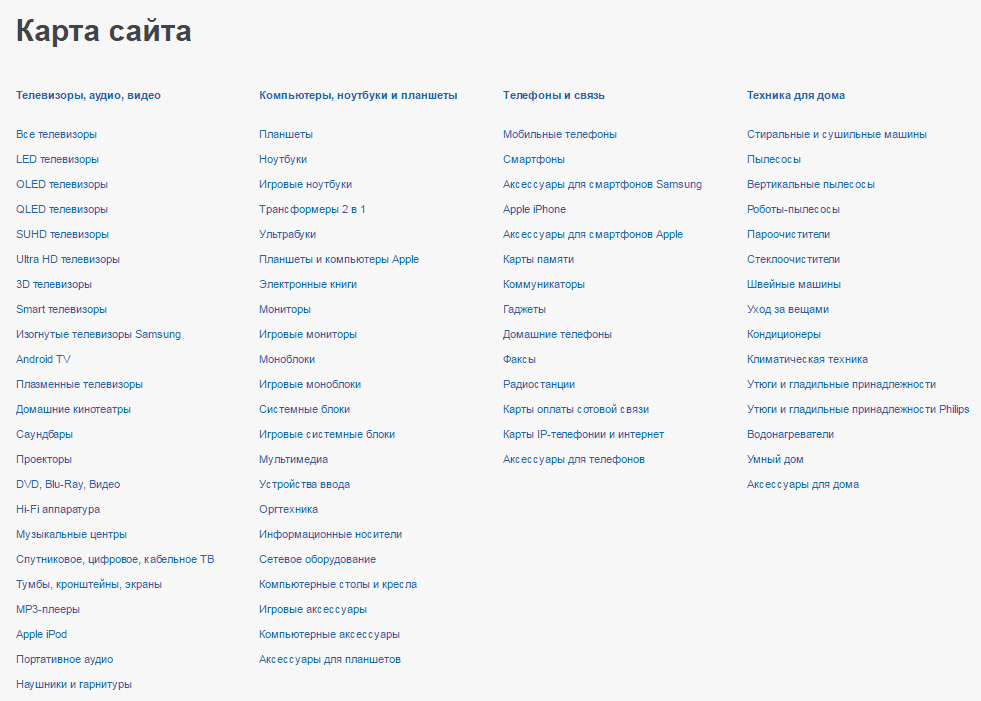

Карта сайта

Помимо карты sitemap.xml, которая важна для поисковых систем, следует также составлять карту сайта в виде html-страницы непосредственно на сайте — для посетителей и поисковых систем.

Карта сайта — страница, на которой содержится полный каталог всех разделов сайта в виде древовидной структуры. Она схожа с оглавлением книги. Посмотрев карту, каждый пользователь может быстро найти необходимую информацию, сориентироваться в структуре и разделах сайта. Желательно, чтобы карта сайта содержала все страницы ресурса.

Карта сайта

Карта сайтаПравила создания карты сайта

Карта сайта должна соответствовать дизайну сайта. Таким образом, она не будет нарушать его концепцию и дезориентировать посетителя.

Использование графических элементов нежелательно. Это необходимо для того, чтобы акцент с полезности не был перемещен на оформление.

Карта сайта должна иметь свою структуру. Структура строится на основе иерархии сайта. Это позволяет посетителю хорошо ориентироваться в разделах веб-ресурса, что, в свою очередь, повышает лояльность.

Ссылку на карту сайта лучше размещать на главной странице. Это делается для того, чтобы было проще найти карту.

Карта сайта должна быть наглядной, но не перегруженной излишними ссылками. Например, если это интернет-магазин, не стоит ссылаться на каждый товар, достаточно основных разделов.

Благодаря карте сайта роботам поисковых системам также проще индексировать ресурс, так как они находят нужные ссылки на одной странице. При отсутствии карты сайта индексация может быть затруднена. Как показывает опыт, поисковые роботы выше ценят сайты, у которых есть навигационные карты. Это относится к требованиям юзабилити, учитываемым при ранжировании.

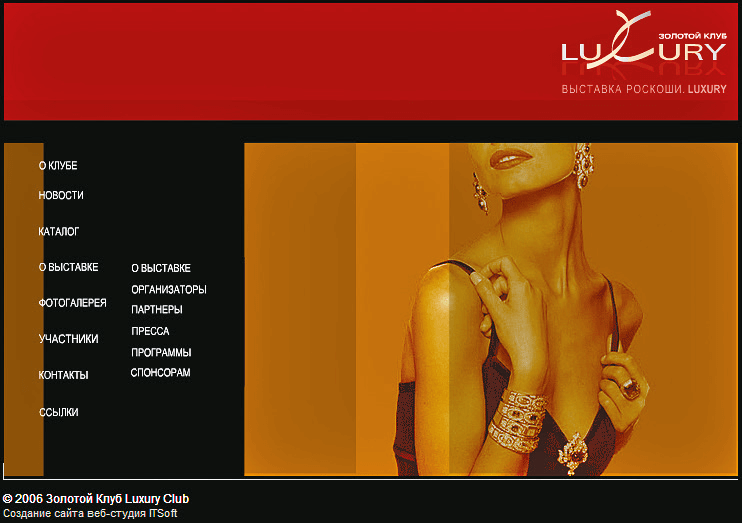

Внутренние корректировки страниц сайта

Для создания сайтов разработано множество технологий, но ресурсы, построенные по некоторым из них, поисковые системы индексировать не умеют.

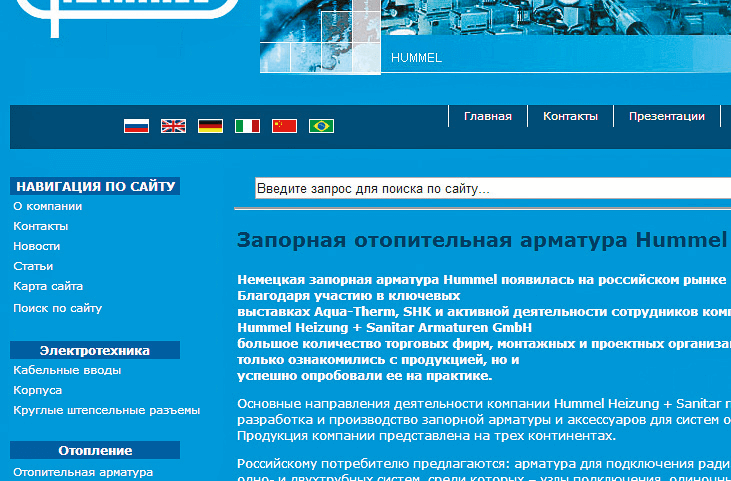

Например, практически невозможно продвигать сайт, если он весь или один из его ключевых элементов сделан с применением технологии flash, frame, JavaScript или метода Parallax с содержанием в одном html-файле.

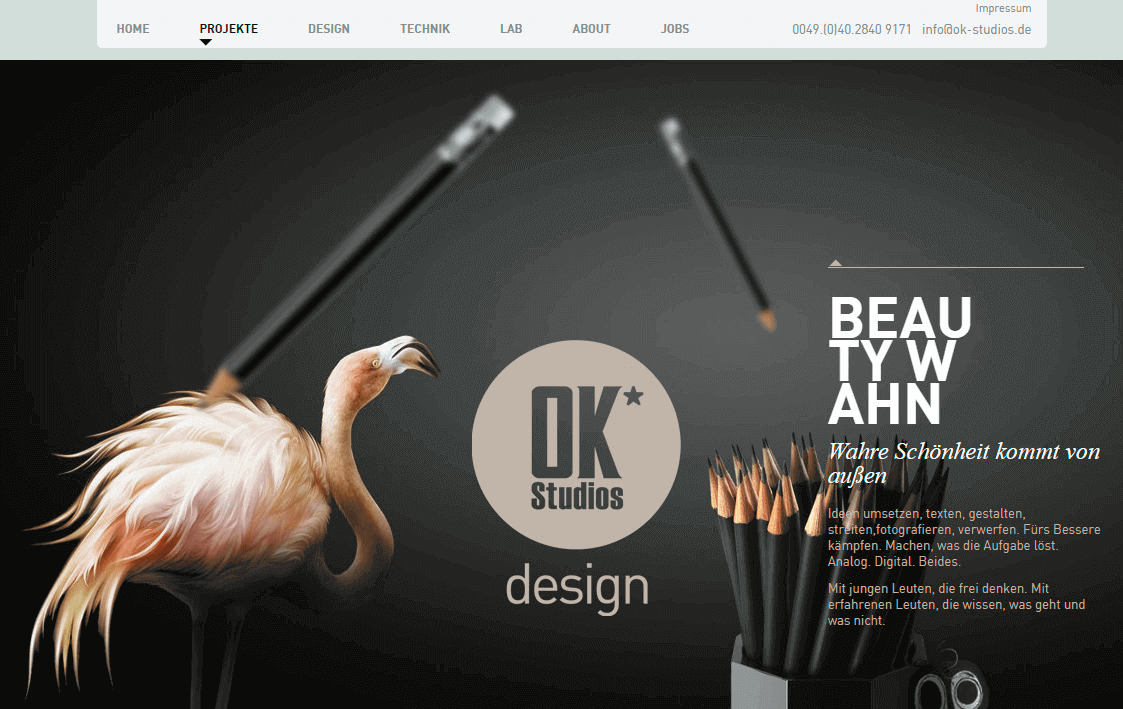

Flash — технология, используемая при производстве reach-media-сайтов или различных элементов сайта: всплывающей рекламы, баннеров, навигации и др.

Технология flash на сайте

Технология flash на сайтеС помощью технологии flash можно создавать красивые сайты, но не читаемые поисковыми системами.

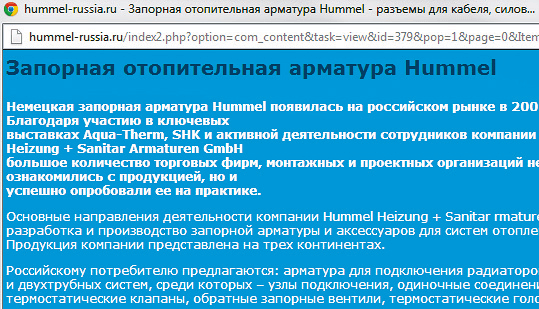

Как видит flash поисковая система

Как видит flash поисковая системаМинусы flash-технологии для продвижения сайта:

Для поисковой системы крайне важен текстовый контент. Если текст и навигация зашиты во flash-объект, то доступ к ссылкам на значимые страницы для поискового робота будет ограничен. Это значит, что и количество ключевых слов, по которым сайт может попасть в топ, уменьшено.

Если во flash-файле находится все содержимое сайта, который представляет собой одну страницу, то возможность распределения ключевых слов по другим страницам отсутствует.

Увидеть контент в браузере без установки flash plugin невозможно.

Как только проблема была обнаружена, нужно сразу оценить ее масштабы. Рекомендуется заменить flash-меню обычным статическим или сделать сквозной ссылочный футер. Его не нужно делать, если навигация на flash уже дублируется в каком-то дополнительном статическом меню сайта.

Если весь сайт или основной контент реализованы на flash, то оптимальным вариантом будет создание сквозного ссылочного футера и размещение контента выше, ниже или сбоку от flash-объекта. Также можно создать html-версии сайта, но этот вариант является более трудоемким.

Минусы JavaScript-технологии для продвижения сайта

Технология JavaScript несет в себе аналогичные препятствия для индексации сайта. Может возникнуть такая ситуация: в браузере отключена поддержка JavaScript, сайт перестает нормально работать, пропадает возможность использовать меню и читать текст. Данная проблема должна решаться веб-разработчиком.

Чтобы вычислить использование JavaScript в меню, нужно навести курсор на ссылку. Если в строке состояния браузера будет отображаться параметр JavaScript, а не обычная ссылка, то поисковые системы ее могут не видеть.

Если используется JavaScript-технология, рекомендуется переписать код сайта с использованием индексируемых форматов. Еще одним вариантом может быть добавление дополнительного статического меню на страницу. Оно будет доступно и пользователям с отключенной поддержкой JavaScript, и поисковым системам.

Минусы frame-технологии для продвижения сайта

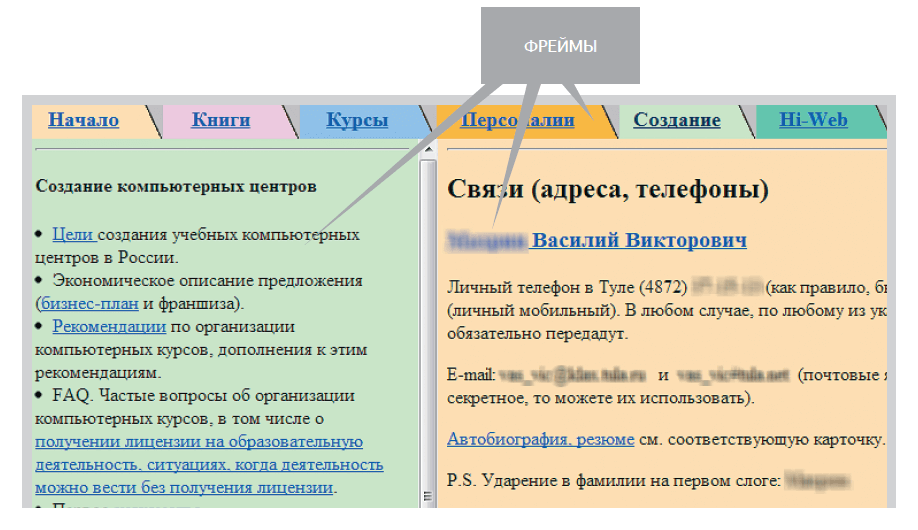

Frame — это еще один формат, который затрудняет индексацию. Он характерен для веб-страниц, использующих множество независимых секций. При этом каждый фрейм строится как отдельный HTML-файл, но с одним мастер-файлом, который идентифицирует каждую секцию. Это можно посмотреть на примере: у различных разделов сайта (фреймов) одинаковый URL.

Frame

FrameФреймы могут стать препятствием для анализа страницы сайта поисковым роботами. К тому же внутри фреймов зачастую нарушена ссылочная целостность. «Яндекс» и другие поисковые системы указывают на допустимость использования тегов frameset, frame. Но нужно учитывать, что использование данного формата накладывает ограничение на доступ к важным областям сайта. Это повышает риск того, что контент сайта с фреймами будет проигнорирован поисковиком.

Фреймы легко обнаружить: страница с ними имеет несколько блоков, у каждого может быть прокрутка. Также фреймы можно обнаружить, если открыть исходный код сайта. Если в исходном коде страницы есть теги frame, frameset, iframe, noframes, то это прямое подтверждение использованию frame-технологии.

Чтобы исправить это, нужно будет реструктурировать верстку страниц сайта. Фрей-мы рекомендуется заменить тегами форматирования таблиц. Так как возможностей для работы с фреймами много, в некоторых случаях можно использовать соответствующие теги (например, noframes). Но, как показывает практика, страницы htmlранжируются обычно выше, чем формат frame.

Минусы Parallax-эффекта для продвижения сайта

Parallax-эффект позволяет создать иллюзию содержимого сайта в 3D-формате. При этом сайт выглядит красиво, но для поисковой оптимизации Parallax-эффект приносит проблемы:

замедление загрузки контента (а ведь скорость загрузки является важным параметром качественной индексации и лояльности посетителей сайта);

ухудшение навигации сайта (посетители вынуждены пролистывать контент до нужного раздела);

ограниченное количество ключевых слов, под которые можно оптимизировать контент, всего один тег title и метатеги.

Parallax-эффекта

Parallax-эффектаДля сайтов с Parallax-эффектом лучше создать несколько страниц с соответствующим набором URL, title, контентом и т. д., которые будут подгружаться при соответствующем действии Parallax-эффекта.

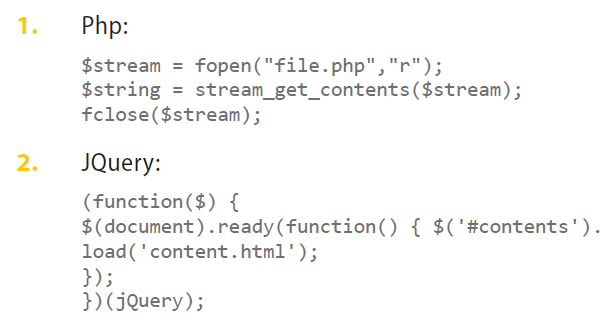

Внешнее содержимое можно загружать следующими способами:

Parallax-эффект в коде

Parallax-эффект в кодеДля достижения желаемого эффекта с Parallax должны работать профессионалы!

Настройка URL страниц

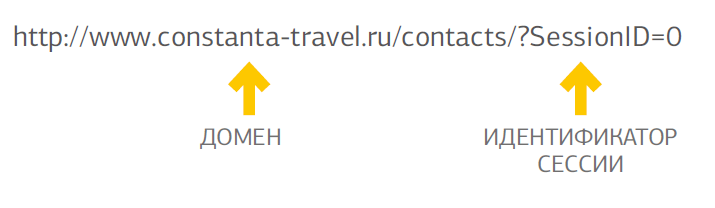

Сложности могут быть связаны не только с технологиями создания страниц, но и с их адресами. К ним относятся URL с идентификаторами сессий и динамические URL, которые увеличивают количество дублей на сайте.

Поисковые роботы воспринимают идентификаторы в качестве уникальных URL, так как при каждом заходе на сайт приписывается новый идентификатор. Из-за этого появляются копии страниц в индексе.

Идентификатор сессии — это уникальный символьный код, добавляемый к URL страницы в целях отслеживания каждого посетителя сайта. Так, в адресе с идентификатором сессии может содержаться SessionID, или SID. URL с идентификатором сессии относятся к динамическим, например:

Идентификатор сессии

Идентификатор сессииДинамические URL — адреса страниц сайта, которые содержат специальные символы («?», «&», «=» и т. д.) и функции, появляющиеся в результате работы различных скриптов сайта, например .

Из-за преобразования URL идентификаторами сессий возникают серьезные проблемы с индексацией. Современные алгоритмы поисковых систем уже достаточно точно могут отсеивать такие адреса, но иногда определить идентификатор невозможно.

Для предотвращения появления дублей в индексе нужно:

запретить индексацию страниц с идентификаторами сессий при первом заходе;

перенаправлять с помощью 301-го редиректа посетителей, которые приходят на страницу с идентификатором сессий. Они должны попадать в итоге на страницу без него, если это не создаст сложности в отслеживании по идентификатору покупок, конверсионных действий и пр.

применить специальный PHP-код, если отказ от использования идентификаторов сессий невозможен. Он будет запрещать открытие сессий для поисковых роботов. Вместо сессии они будут получать ошибку 404.

Для запрета индексации страниц с идентификаторами сессий необходимо в файл .htaccess добавить строки:

php_flagsession.use_trans_sidOff (передача идентификатора отключается, т. к. он добавляется к URL);

php_flagsession.use_only_cookieOn (сервер получает указание передавать идентификаторы через cookie);

php_flagsession.auto_startOn.

Кроме того, для закрытия от индексации страниц с идентификаторами сессий можно:

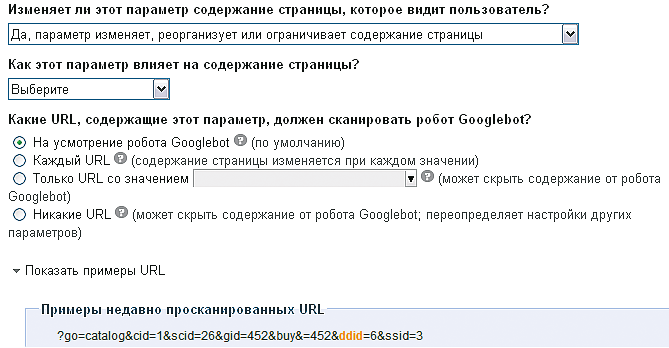

использовать инструменты самих поисковых систем. Для «Яндекса» следует прописать в директиве Clean-param все адреса страниц сайта с динамическими параметрами, не изменяющими содержание страниц. Для настройки Google нужно зайти в инструменты веб-мастера в раздел «Конфигурация сайта — Настройки — Обработка параметров» и задать динамические параметры, которые роботы будут игнорировать. Таким образом, у страниц, которые добавляются в индекс, из URL будет удаляться идентификатор сессий;

указать в атрибуте rel="canonical" тега link URL канонической страницы без идентификатора.

Оптимизаторы зачастую вместо динамических URL настраивают псевдостатические URL или ЧПУ, тем самым организуя 301-й редирект с динамических страниц на статические. Избавление от идентификаторов сессий и динамических адресов является важным этапом внутренней оптимизации сайта. Такая работа направлена на устранение дублей страниц в индексе и получение корректного ранжирования основных страниц.

В этот процесс входит преобразование ссылок из динамических в псевдостатические за счет прописанных в базе данных alias-URL и настройки ЧПУ на уровне CMS-сайта. Затем нужно настроить ЧПУ на уровне сервера. Для этого в файл .htaccess нужно добавить правило mod_rewrite для внутреннего преобразования URL. В завершение настраивается 301-й редирект.

Формирование ЧПУ

Зачастую, когда динамические URL заменяются на псевдостатические, адрес страницы выглядит как ее заголовок, но транслитерацией. ЧПУ («человекопонятный урл») представляет собой формат адресации страниц сайта, который удобен для восприятия человеком.

Пример того, как выглядит ЧПУ: http://promo.ingate.ru/prodvizhenie-sajta/

При формировании ЧПУ не стоит забывать об основных принципах:

Все адреса на сайте должны иметь исходный формат, например:

,

,

и т. д.

Размер адреса для новых страниц не должен быть слишком большим (не более 50–70 символов) или содержать спам (несколько ключевых слов).

В ЧПУ могут быть включены транслитерированные вхождения продвигаемых запросов (или англоязычные запросы). Они играют важную роль в продвижении сайта в поисковых системах. При настройке ЧПУ на сайте важно провести настройку корректного редиректа со старых адресов на новые.

Многие из современных CMS могут поддерживать ЧПУ на базовом уровне и иметь собственные алгоритмы формирования адресов, что значительно облегчает работу веб-мастера. Тем не менее только сам человек может выбрать наилучший способ, исходя из особенностей сайта.

Нельзя недооценивать ЧПУ в вопросе продвижения высококонкурентных запросов на внутренних страницах. Поэтому, если есть динамические URL, следует заранее подготовить псевдостатические адреса в формате ЧПУ.

Устранение битых ссылок

Битые ссылки — это ссылки, ведущие на несуществующую страницу сайта (которая отдает код 404). Они появляются при замене динамических URL на псевдостатические, когда перенаправление не реализовано, либо когда страница с сайта уже удалена, но с других ресурсов ее не убрали, либо когда в URL страницы есть ошибка.

Битые ссылки на сайте подрывают лояльность посетителей и становятся источником проблем для поисковых роботов, так как переводят на несуществующие страницы. Они вызывают недоумение людей, почему ссылка поставлена на отсутствующую страницу и не дают поисковой системе попасть на страницу и проиндексировать действительно важный контент. Такие ссылки должны быть вовремя устранены.

Выявить битые ссылки можно при исследовании навигации сайта. Если на сайте есть страницы, при переходе на которые отдается 404-й ответ, это говорит о том, что они битые. Для исправления ситуации следует предпринять действия:

по восстановлению контента на битых страницах;

удалению ссылок на битые страницы с других страниц сайта (если контент на битых страницах не будет восстанавливаться);

исправлению URL на корректный, если в адресе есть ошибка.

Если такие действия представляют большую сложность, нужно в файле robots.txt закрыть битые страницы от индексации.

Основная задача технической оптимизации сайта состоит в предоставлении поисковому роботу доступа к полезному контенту на сайте. И чем его больше, тем лучше. Робот индексирует контент и предоставляет пользователю ответ на его поисковый запрос. Если на сайте есть битые ссылки, возможность индексации содержимого сайта ограничивается.

Дубли страниц

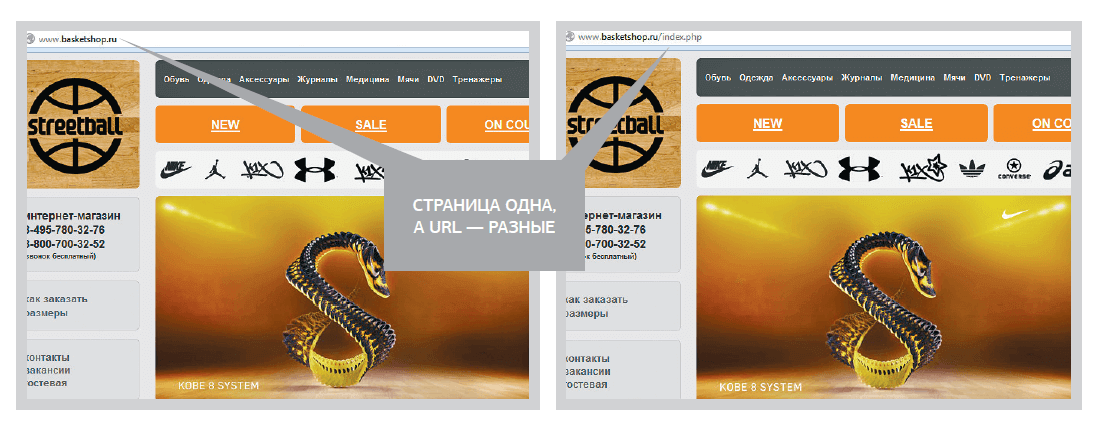

Для поискового продвижения важно, чтобы на сайте не появлялись лишние страницы, дублирующие существующей контент. Их наличие чревато некорректным выбором релевантной страницы и наложением санкций на сайт.

Есть два вида дублей:

полные — страницы, идентичные по содержанию, у которых различаются только URL;

нечеткие — страницы, содержащие большое количество одинаковой информации, но не полностью идентичные, их URL также различны.

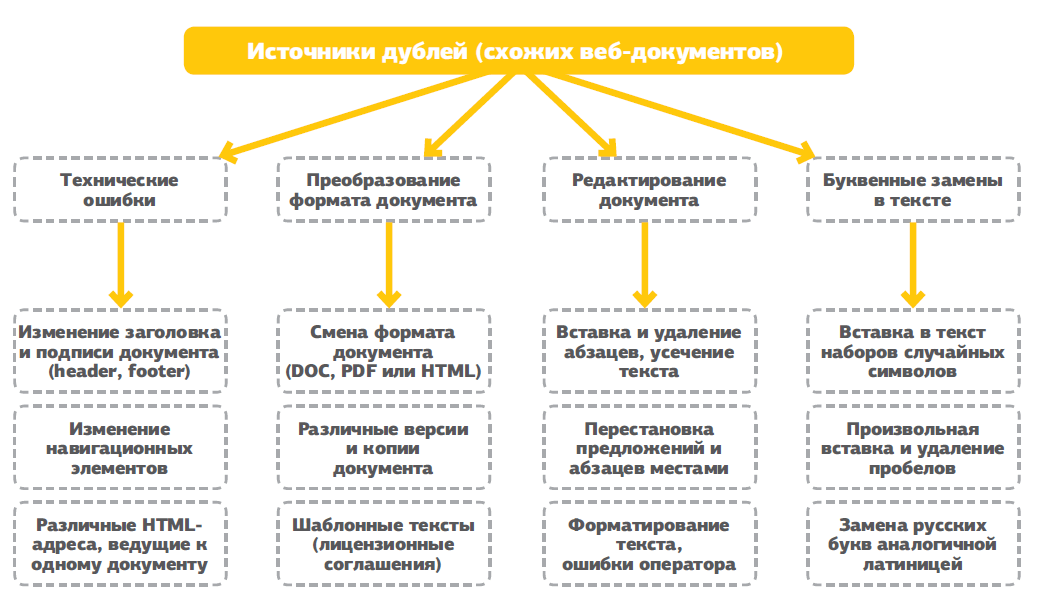

Источников возникновения дублей в Сети несколько. Иногда они появляются из-за технических недоработок веб-мастеров, иногда — в результате осознанного влияния оптимизатора на ответ поисковой машины.

Дубли страниц

Дубли страницВладелец и разработчик сайта в ответе за технические ошибки и форматы документов. В некоторых случаях дубли текста — это результат кражи контента с сайта-первоисточника. Но это уже другая тема, которая не имеет отношения к технической оптимизации. Дальше поговорим о недоработках на сайте, которые автоматически генерируют дублированные страницы.

Зачастую проблему можно решить устранением всех дублей, их адреса будут отдавать посетителям и поисковой системе ошибку 404. Также необходимо изъять все образовавшиеся битые ссылки.

Всю работу с дублями можно проделать в несколько шагов:

в файле robots.txt закрыть от индексации имеющиеся на сайте дубли;

если формируются страницы, которые являются дублями, прописывать в их метатеги [meta name="robots" content="noindex,nofollow"]. Так будет запрещена индексация данных страниц и переход по ссылкам с них;

на всех автоматически генерируемых страницах использовать тег [link rel="canonical" href="адрес оригинала" /].

Но каждый случай появления дублей стоит рассмотреть отдельно, чтобы применить подходящие меры для конкретного сайта. Ниже описаны наиболее частые причины автоматической генерации дублей, а также варианты их устранения.

«Листалки»

На сайте с многостраничным каталогом часто вторая, третья и последующие страницы содержат большой объем повторяющейся информации. Это одинаковые текстовые блоки или метатеги, отображающиеся на всех страницах каталога из-за особенностей CMS сайта. Таким образом, есть множество страниц с один и тем же текстом. Хуже, если этот текст оптимизирован для продвижения. Получается, что он растворяется во множестве дублей.

Чтобы устранить проблему дублирования контента в «листалках», следует воспользоваться следующими методами:

Через robots.txt или метатег «ROBOTS» закрыть все дублирующиеся страницы или использовать тег rel="canonical«.

Поработать над тем, чтобы значимые текстовые блоки отображались только на первой странице и не повторялись на остальных. Это рациональное решение, если в продвижении задействована только первая страница и на ней будет весь контент, релевантный запросу. Эта работа выполняется разработчиками, но им следует указать на ее необходимость.

Листалки

ЛисталкиДубли контента на страницах «листалок» не единственная проблема. Довольно часто можно столкнуться с одинаковыми метатегами на всех страницах каталога. Это не приносит большого вреда, но, если их уникализировать, это даст дополнительные бонусы при ранжировании ресурса. Наиболее удобным вариантом работы с метатегами является создание единого шаблона title и метатегов, привязанных к содержанию страницы.

Зачастую в «листалку» включено развернутое описание товара, при этом такой же текст есть на странице с карточкой товара. Это и есть причина дублирования контента, которая может негативно сказаться на ранжировании. Поисковый робот не понимает, какую страницу считать более релевантной.

Чтобы устранить такое дублирование, можно:

в файле robots.txt закрыть страницы «листалки»;

в «листалках» публиковать небольшую часть из описания товара или услуги и давать ссылку на полную версию описания или на карточку товара.

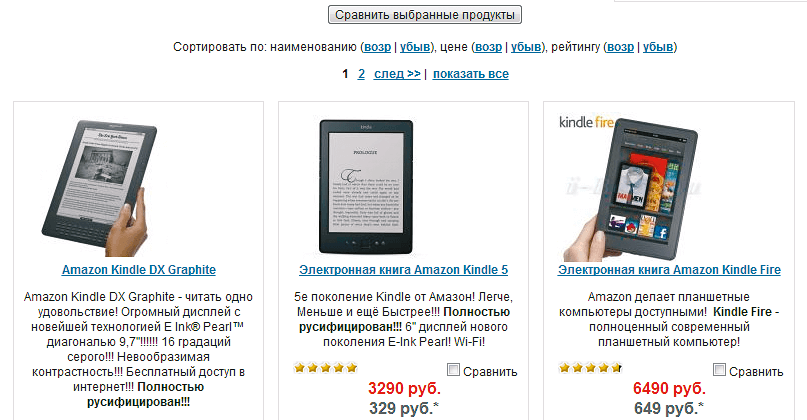

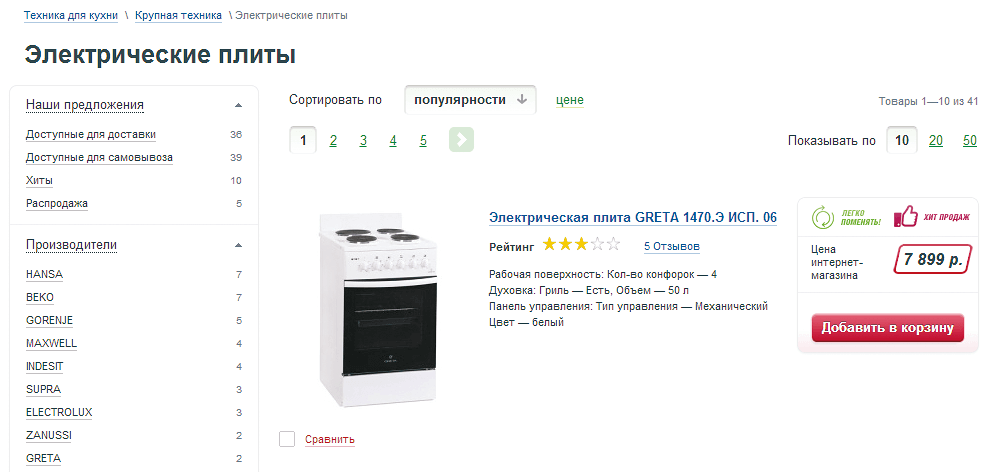

Сортировка, фильтрация и поиск

На сайте могут быть формы сортировки, фильтрации и поиска, тогда результат будет формироваться на отдельной странице с динамическим URL. На этой странице могут содержаться фрагменты текстов с других страниц сайта. Если работа с многочисленными страницами поиска не проводится, то они остаются открытыми для индексации.

Результат сортировки, фильтрации и поиска

Результат сортировки, фильтрации и поискаВ сортировке участвует ряд категорий, поэтому на одной сгенерированной странице могут сочетаться разные товары, а, к примеру, поиск по двум разным словам может привести к одному результату. Наличие множества автоматически сгенерированных страниц нарушает лицензию поисковых систем.

Наиболее простым способом борьбы с подобными дублями является закрытие страниц результатов от индексации в файле robots.txt. Такая строчка может выглядеть сле-дующим образом: Disallow:/search=*.

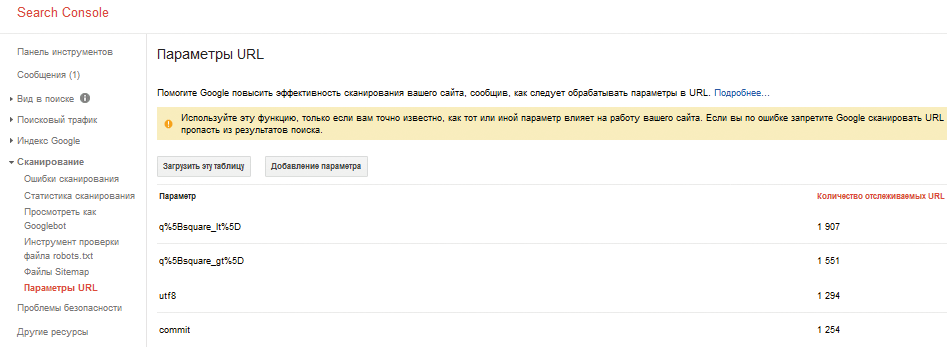

Периодически необходимо анализировать URL страниц сайта, которые попадают в индекс. Это поможет своевременно устранять проблемы с сортировкой, фильтрацией и поиском. Анализ может проводиться следующими методами:

Проверить параметры, которые найдены в сервисе Google «Инструменты для веб-мастеров» и которые указаны в разделе «Сканирование — Параметры URL».

Параметры URL в Яндекс.Вебмастере Сканирование — Параметры URLНекорректные URL в Google

Сканирование — Параметры URLНекорректные URL в Google Примеры некорректных URL в Google

Примеры некорректных URL в GoogleВыбрать параметры, являющиеся незначащими, и указать в Google Webmaster команду «Пропускать при индексации». Чтобы настроить сайт под «Яндекс», необходимо прописать данные параметры в файле robots.txt в качестве масок для закрытия от индексации.

Оценить адреса страниц в индексе, используя «Яндекс.Вебмастер» (раздел «Индексирование — Страницы в поиске»). Определить одинаковые метатеги (такая возможность есть также в сервисе Google Search Console), одинаковые адреса с переставленными параметрами, например первый «/?pr=gr&cost=big» и второй «/?cost=big&pr=gr». Также вычислить количество страниц одной статьи за счет комментариев. После выявления дублей следует обратиться к разработчику, который закроет их от индексации.

Найти и устранить причину дублей с помощью одного из перечисленных ранее способов или скомбинировать их. Идеальный вариант — полный анализ структуры сайта и алгоритмов формирования URL.

Сортировка, фильтрация и поиск — важные навигационные элементы сайта. Без них невозможно представить работу ресурсов, особенно крупных, так как это значительно влияет на юзабилити. Но, используя данные элементы, нужно быть готовым к возможным проблемам с дублированием, регулярно проводить проверки и устранять выявленные недочеты.

Версия для печати

Страница «Версия для печати» повышает удобство использования сайта. Ссылки на такие страницы лучше проставить на всех карточках товаров, а также на странице контактов и в других значимых разделах. При этом страница с версией для печати дублирует весь контент, но на ней нет графической составляющей.

Страница с версией для печати

Страница с версией для печати Версия для печати

Версия для печатиЧтобы решить проблему нечетких дублей в этом случае, нужно обратиться к методам по устранению полных дублей. Можно использовать атрибут rel=canonical, метатег «robots» или прописать запрет на индексацию в файле robots.txt. Но в последнем варианте ссылка с оригинала будет передавать вес на страницу версии для печати. Это, в свою очередь, приведет к потере веса продвигаемой страницы. Чтобы не допустить этого, нужно закрыть ссылку «Версия для печати» дополнительным тегом nofollow. Так робот не будет переходить по этой ссылке со страницы-оригинала и ошибок сканирования удастся избежать.

Версия страницы для печати может быть также создана при помощи технологий JavaScript и CSS. Так, проблема с дублями будет решена и взаимодействие сайта со сканирующим роботом оптимизировано. Но этой работой должен заниматься веб-разработчик.

CMS и неосознанные дубли

В некоторых системах управления сайтом (CMS) дубли страниц создаются автоматически. Так происходит, например, в WordPress: дубли появляются из-за того, что контент повторяется в анонсах и на основных страницах. Другой популярной CMS является Joomla, она тоже создает множество дублей из-за того, что одна и та же страница может быть получена различными способами.

Самой распространенной ошибкой является передача лишних параметров. Эта проблема характерна более чем для 90 % движков. К примеру, site.ru/index.php?id=602 является исходной страницей, поэтому она должна индек-сироваться. Идентификатор сессий и особенности формирования динамических страниц порождают дубли: site.ru/ index.php?showid=602&fs=12&345?SessionID=98765432156789.

Есть еще вариант, когда главная страница находится по разным адресам, например и .

Как правило, средства самой CMS закрывают часть дублей от индексации, но есть и другая часть. С ней уже надо дополнительно работать, используя описанные ранее методы: настройка robots. txt (директивы clean-param и/или запрета индексации дублей), устранение битых ссылок, установка 301-х редиректов.

Зачастую проблемы с дублями возникают при переносе сайта с одной CMS на другую. Тогда происходит наложение старых параметров на страницы нового движка. Это может стать причиной образования множества дублей. Поэтому, если сайт переносится, первое время следует тщательно контролировать техническую сторону вопроса.

Дубль страницы

Дубль страницыВнутренние и внешние дубли

Иногда дубли создаются не автоматически, а вполне осознанно. Например, есть две страницы — главная и «О компании», которые дублируют содержание друг друга, так как раньше не было времени написать новый текст для одной из них. Или же это каталог, в котором много однотипной продукции. Идеальный вариант — сделать все эти страницы уникальными. Но если он невозможен, то можно прибегнуть к ранее перечисленным советам.

Санкции за внутренние дубли на сайт не накладываются, но часто возникают сложности в передаче веса. Если кто-то украл контент и у сайта появились внешние дубли, то возможна пессимизация сайта со стороны поисковых систем.

Бывают и такие случаи: уникальная информация с сайта растаскивается по Сети, из-за чего сайт не может занять высокие позиции. Такая ситуация оправдана главным принципом поисковых систем: информация в выдаче должна быть релевантной, актуальной и качественной. Если контент неуникальный, он не может быть качественным. Его наличие приводит к увеличению индексных баз поисковых систем и повышению нагрузки на поисковые серверы.

Как защитить свой контент

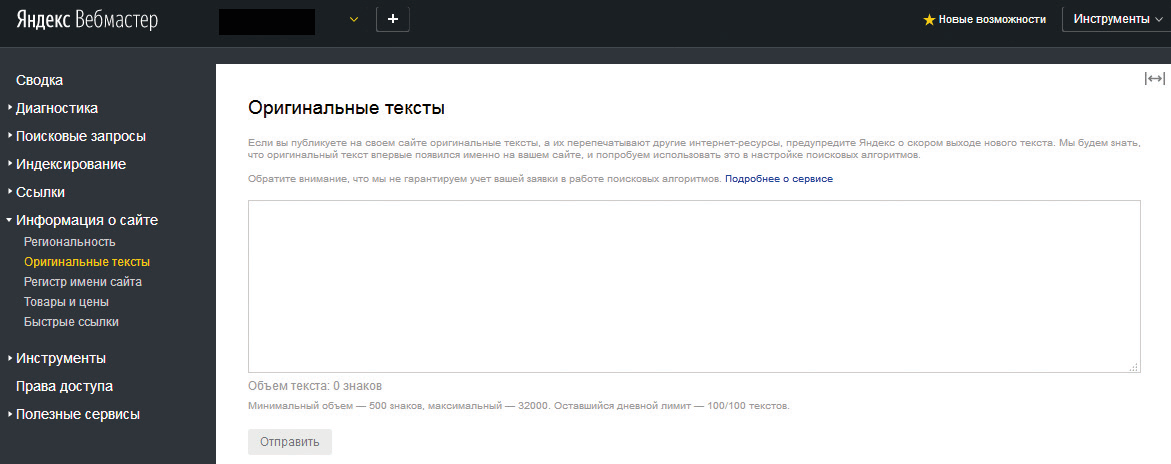

Поисковые роботы зачастую не могут определить первоисточник контента, но такие исследования ведутся. Например, в «Яндексе» можно сообщить о появлении уникального контенте до его публикации через сервис «Оригинальные тексты». С его помощью можно загрузить до 100 текстов объемом от 500 до 32 000 символов в сутки. Если объем текста больше 32 000 символов, его стоит разделить на 2 части, учитывая нижнюю границу. Таким образом, если произойдет кража контента, «Яндекс» вычислит правонарушителя, а позиции основного сайта не понизятся в выдаче.

Оригинальные тексты в Вебмастере Яндекса

Оригинальные тексты в Вебмастере ЯндексаЧтобы ускорить работу с сервисом «Оригинальные тексты», следует автоматизировать подачу текстов в него параллельно с выкладкой на сайт с помощью API «Яндекс.Вебмастера».

Если же вы сами позаимствовали контент на других ресурсах, то ваш сайт потеряет доверие поисковых систем, возникнут сложности с его продвижением. При отборе в топ-10 учитываются даже малейшие недочеты (не в вашу пользу). Первая десятка сайта должна быть полностью отвечающей на запрос пользователя и разнообразной, сайтов с двумя одинаковыми текстами в ней быть не может.

Чтобы запретить копировать текст с вашего сайта, нужно заменить тег b o d y на тег bodyoncopy="return false". Также можно использовать специальный JavaScript. Он будет запрещать пользователям использовать правую кнопку мыши на веб-странице. Это затруднит копирование текста и изображений. Можно, конечно, скопировать текст через исходный код страницы, но при этом сохранятся все ссылки.

Таким образом, уникальный контент является одним из главных требований, которые предъявляются к сайту. Уважайте авторские права других людей!